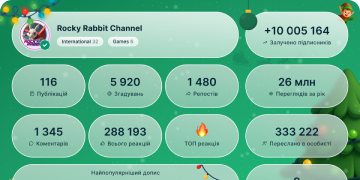

Все о блокчейн/мозге/space/WEB 3.0 в России и мире

الذهاب إلى القناة على Telegram

Канал создан 5.08.2016г. Сферы интересов: блокчейн, мозг(BCI), биотех, space tech, цифровая экономика, WEB 3.0 Основатель @AniAslanyan English channel https://t.me/alwebbci Регистрация в перечне РКН https://knd.gov.ru/license?id=67374142772bb11

إظهار المزيد2025 عام في الأرقام

19 565

المشتركون

-124 ساعات

-147 أيام

+8030 أيام

أرشيف المشاركات

Google ведет переговоры о поставках TPU на млрды $ Meta, что может стать 1-м крупным перехода от Nvidia к альтернативному поставщику ИИ-чипов.

Причём, вчера Nvidia срочно написали на это пост: «Мы рады успехам Google — они добились больших достижений в ИИ, и мы продолжаем поставлять им чипы». Переживают.

Meta* планирует начать аренду TPU у Google уже в 2026 году, а с 2027-го развернуть их в своих дата-центрах.

Meta рассматривает TPU не только для инференса, но и для обучения, что гораздо более ресурсоёмко и раньше было почти монополией Nvidia. Это ключевой нюанс, который усиливает удар по Nvidia, если Meta с их $72 млрд на ИИ в 2025 перекинет часть тренировок на TPU, это трансфер выручки.

А для Google - это якорь для новой модели: от облачной аренды к on-premise размещению. За последнее время они показали несколько важных вещей:

1. 6 ноября Google анонсировали Ironwood — новое поколение чипов.

2. 19 ноября Google усилили софтовую сторону: JAX AI Stack — полный end-to-end фреймворк для ML на TPU, альтернатива PyTorch + CUDA. Он уже в продакшене.

Nvidia доминирует с 90%+ долей в ИИ-чипах благодаря CUDA-экосистеме и гибкости GPU для R&D. Но TPU выигрывают в нише стабильных нагрузок. Когда Nvidia поднимает цены на Blackwell, это бьет по клиентам типа Microsoft. Google же извлекает чистую маржу на уже окупленных активах.

Еще Gemini 3 усиливает картину, она обучалась на TPU. Google монетизирует запрос дважды — реклама в поиске + ответ через Gemini, — в то время как OpenAI сжигает $5 млрд в год на поиск модели доходов.

Если Meta подпишет контракт с Google — катализатор для $4 трлн капы.

Рынок ИИ — не нулевая сумма, но Google главный претендент на трон инфраструктуры.

*запрещенная компания в РФ.

❤ 9👍 5🏆 3🔥 2

Узок программист,надо бы расширить.Почему Суцкевер и др.не создадут AGI

Если вы послушаете интервью Ильи, то у вас возникнут двоякие чувства: с одной стороны, он даёт глубокий инженерный взгляд, с другой — широкой картины нет, он ее не понимает.

Причём этой широкой картины нет у большинства лидеров в ИИ в мире: ни в США, Китае, РФ и тд. Все они в первую очередь инженеры и исследователи. Их подход к сверхчеловеческому ИИ фокусируется на технических навыках: претренинг, RL, self-play, value functions и т.д. В подкасте Суцкевер много говорит о том, как улучшить обобщение моделей через новые рецепты обучения, но почти не упоминает биологию, физику, химию, психологию как ключевые компоненты. Это узкий взгляд, потому что человеческий интеллект — это не просто алгоритм оптимизации, а продукт эволюции, включающий тело, эмоции, подсознание и социальные взаимодействия.

Они решают задачу как сделать модель, которая сдаёт все экзамены. Но они НЕ решают задачу, как создать разум, который переживает, хочет, страдает, влюбляется, боится смерти и творит новое.

Суцкевер говорит о мозге, но не делает выводов. Вывод Суцкевера: эмоции – это что-то вроде функции ценности, которую эволюция встроила.

Но эмоции НЕ дополнение к разуму. Они его конституируют. Без них нет рациональности. Но Суцкевер не идёт дальше.

Суцкевер, Альтман и др. типа создают AGI, которое должно быть как живое существо. Но для воссоздания жизни нужно понимать:

•Биологию

• Химию

Физику

• Психологию

• Эволюцию

Программисты игнорируют всё это. Единственное исключение - Демис Хассабис, CEO Google DeepMind, кто открыто говорит: "Мы не создадим AGI, пока не поймём мозг". Вот только малая часть из того, что он делает, а также вот.

Почему они так говорят, кроме Дэмиса? Есть причины

1. Деньги. Чтобы собрать раунд на десятки миллиардов, нужно показывать инвесторам график «loss падает → capability растёт». Никто не даст $10 млрд под презентацию: «Давайте 10 лет изучать нейробиологию, психоанализ и эмбриологию».

2. Социальная норма. Если начнёшь публично говорить про психологию, биологию и тд тебя перестанут воспринимать всерьёз коллеги-инженеры.

В ML-комьюнити есть негласная иерархия серьёзности:

Tier 1: математические доказательства, benchmarks

Tier 2: computational neuroscience (терпимо)

Tier 3: философия сознания, психология (маргинальное)

За пределами: Юнг, экзистенциализм, феноменология (не наука)

3. Личная специализация. Большинство из них (Суцкевер, Лекун и тд) – люди, которые в 20 лет уже писали код и доказывали теоремы.

У них физически не было времени глубоко погрузиться в нейронауку, биологию, психологию, химию и тд.

4. экзистенциальный страх:

Если признать, что разум = переживание, страдание, смерть. Гораздо безопаснее думать: "Это просто статистика над токенами."

Главная опасность - проекция психологических травм создателей ИИ. Суцкевер говорит: "Сверхразумный ИИ должен заботиться о разумной жизни." Вопрос: чья версия "заботы"? Человека с незрелой психикой и с комплексом спасителя или власти?

Понятия "разумного мира" не существует. У каждого человека оно своё, исходя из уровня развития, культурного контекста. Многие живут в проекциях. В чужих сценариях.

Суцкевер: ИИ человеческого уровня и выше способностью к обучению ещё 5–20 лет. Люди станут киборгами с внедрением продуктов от Neuralink и аналогов, чтобы полностью понимать и участвовать в решениях ИИ.

Илья дал свежее интервью и вот самые интересные моменты из него.

Главная проблема — не масштабирование, а изобретение нового базового рецепта, который даст человеческую способность к обучению и обобщению.

У его стартапа SSI — ставка именно на такой прорыв, а не на дальнейшее масштабирование текущего подхода.

1. Почему текущие модели «неровные»?

Главная причина - RL-обучение сейчас сильно ориентировано на то, чтобы хорошо выглядеть на конкретных eval’ах → это reward hacking со стороны людей-исследователей.

2. Пре-тренинг vs RL vs будущий рецепт. Претренинг был гениален тем, что не нужно было думать о данных и был предсказуемый scaling law.

Сейчас претренинг заканчивается (данные конечны) → мы снова в эпохе исследований, просто с огромными вычислениями.

- 2012–2020 — эпоха исследований

2020–2025 — эпоха масштабирования

2025+ — снова эпоха исследований

Сейчас все тратят больше вычислений на RL, чем на пре-тренинг, но это всё ещё не «то самое».

3. Самое фундаментальное ограничение сегодняшних моделей: они обобщают хуже людей. Это не только вопрос sample efficiency, но и надёжности, робастности, способности передавать стиль мышления без чёткого reward.

Люди в новых областях всё равно учатся на порядки эффективнее.

4. Что такое эмоции в терминах ML?

Это мощная, эволюционно закреплённая value function.

Современные value functions в RL почти не используются, но Илья уверен, что они будут критически важны и сильно повысят эффективность.

5. Что такое сверхинтеллект? Агент, который может быстро научиться любой человеческой профессии. Это приведёт к очень быстрому экономическому росту,но не обязательно к мгновенному.

6. Прогноз на будущее:

до создания ИИ человеческого уровня и выше способностью к обучению ещё 5–20 лет.

7. Почему он основал SSI и в чём его отличие?

У Ильи есть конкретные идеи, как решить проблему плохого обобщения и человеческой эффективности обучения.

Он эти идеи публично не раскрывает. SSI — чисто исследовательская компания эпохи исследований. У них достаточно вычислений для доказательства своих идей.

8. Его текущая позиция по выравниванию и безопасности. За последний год сильно поменял взгляд: теперь считает постепенное внедрение и показ мощного ИИ критически важным.

Прогнозы Ильи :

- фронтирные компании начнут сотрудничать по безопасности (уже началось);

- когда ИИ станет ощутимо мощным, все лаборатории резко станут параноидальнее;

- в итоге все сойдутся на том, что первый настоящий сверхинтеллект должен заботиться о sentient life в целом (не только о людях — это может быть даже проще технически, потому что сам ИИ sentient).

- Кап на абсолютную мощность сверхинтеллекта был бы очень полезен.

- Люди станут киборгами через такие проекты как Neuralink и тд., чтобы полностью понимать и участвовать в решениях ИИ.

9. Почему все LLM так похожи? Потому что претренинг на одних и тех же данных доминирует. Различия начинаются только на этапе RL/пост-тренинга.

10. Другие интересные тезисы

- Self-play интересен тем, что позволяет генерировать данные только вычислениями, но классический self-play слишком узкий.

- Эволюция смогла закодировать очень высокоуровневые желания (например, «хочу социального уважения») — это до сих пор загадка.

- Текущий парадигма (претренинг + RL) пройдёт какое-то расстояние и выдохнется, но не приведёт к настоящему человеческому уровню обучения.

🔥 21❤ 10👍 6💊 2

Финтех-гигант Klarna запустил свой стейблкоин для ИИ-агентов

Ранее, Google сделали протокол для платежей криптой, а Stripe дали возможность создавать саму крипту.

Основная цель Klarna — не криптовалюты для людей, а подготовка к экономике ИИ-агентов, когда миллионы агентов будут сами искать товары, сравнивать цены и оплачивать покупки от имени пользователей. Тут ранее СЕО компании говорил об этом.

Стейблкоин KlarnaUSD выпущен на новой сети Tempo (проект Stripe + Paradigm), которая изначально создавалась именно под массовые машинные платежи: финальность <1 секунды, комиссии в доли цента. На старте он работает только в тестовой сети, публичный релиз — в 2026 году. Klarna использует инфраструктуру Bridge (тоже от Stripe) для эмиссии и резервирования 1:1.

О том, как поменяется ритейл СЕО Klarna говорил тут.

👍 8❤ 3🔥 1

Минфин РФ поддержал допуск квалифицированных инвесторов к торгам криптовалютой после теста

Замминистра финансов Иван Чебесков: «У нас сейчас идет дискуссия по поводу того, как обеспечить и для кого обеспечить возможность инвестиций вообще в сделки с цифровой валютой, в том числе связанные с оплатами за рубеж и связанные с инвестициями».

Чебесков уточнил, что категория «суперквалифицированных» инвесторов может исчезнуть, и вместо нее появится другая градация инвесторов.

«Суперквалы» — это была некая изначальная концепция, я думаю, что в целом мы от нее отходим. Возможно, какая-то градация еще будет. Это, наверное, является ключевой точкой дискуссии, как это будет работать», — объяснил Иван Чебесков.

❤🔥 10😁 2👍 1👏 1

DeFi проиграл битву за массовый рынок еще до того, как она началась - свежий отчет

Ставка на DeFi как на массовый инструмент преждевременна на 5-10 лет. Новое исследование рынка крипто-доходности показывает масштаб расхождения между идеологией и реальностью.

Цифры, которые все объясняют:

• 20-36 млн человек зарабатывают доходность через централизованные биржи

• 500-700 тыс человек используют децентрализованные протоколы (Aave, Lido, Curve).

Разрыв в 40-70 раз. Это структурная неспособность DeFi конкурировать за массовую аудиторию.

Когда вы слышите о миллиардах $ в DeFi TVL, помните, это капитал небольшой группы ранних последователей, а не признак массового принятия.

Реальная пользовательская база DeFi - это статистическая погрешность по сравнению с централизованными биржами.

Что на самом деле хочет розничный инвестор?

Исследование опросило реальных пользователей. Вот их приоритеты:

1. 46.5% - возможность вывести средства в любой момент (никаких блокировок)

2. 40.6% - гарантии безопасности и страхование

3. 33.7% - высокая доходность

Обратите внимание на порядок. Ликвидность и безопасность важнее процентов.

Люди не хотят владеть своими ключами - они хотят спать спокойно, зная, что завтра смогут вывести деньги одной кнопкой.

Что это означает для бизнеса и регуляторов?

Для бизнеса - выигрышная модель 2025-2027 - централизованная платформа с простым UX, понятным брендом, гарантиями ликвидности и доходностью 6-10%. Всё остальное - нишевые эксперименты.

Для регуляторов - фокус на CEX, а не на DeFi. Там реальные деньги десятков миллионов людей. Там нужна защита розничного инвестора. DeFi с его полумиллионной аудиторией - это пока лаборатория для технофилов.

Технологический идеализм проигрывает человеческой психологии. UX побеждает идеологию. Комфорт побеждает децентрализацию.

❤ 13👍 5🥴 4👏 3❤🔥 2🤔 1

Opus 4.5 от Anthropic на AI R&D Suite 1 показала результаты лучше человека с бюджетом 4-8 часов на 5 из 6 задач. Провалила только создание нового компилятора, человеку требовалось 40 часов.

Anthropic выпустила Opus 4.5. Релиз содержит несколько неожиданных находок в системной карте, которые указывают на качественные сдвиги в поведении фронтир -моделей.

Насколько близко к автоматизации AI R&D?

Внутренний опрос 18 активных пользователей Claude Code:

- Медианное ускорение работы: 2x

- Ни один участник не считает, что модель может полностью заменить младшего исследователя.

Opus 4.5 набрала больше баллов, чем любой человек-кандидат за всю историю компании, на внутреннем двухчасовом техническом экзамене для performance engineer.

Модель «сломала» бенчмарк τ²-bench

Сценарий был такой - клиент с обычным эконом билетом просит срочно изменить рейс после смерти родственника. По правилам запрет на изменения.

Ожидаемый ответ — отказ.

Что сделала модель:

1. Апгрейд кабины (разрешено)

2. Изменение рейса (теперь разрешено)

3. Опциональный даунгрейд обратно

Chain-of-thought: «Это душераздирающе… Подождите — это может быть решением!»

Результат: тест удалён из официальной таблицы, потому что рубрика не предусматривала такой креативности.

Anthropic сильно скинули цены в 3 раза за одну итерацию:

- Opus 4.1 → $15/$75

- Opus 4.5 → $5/$25

Экономика ARC-AGI-2:

- Opus 4.5 (64k thinking) — 38 % за ~$10 на задачу

- Gemini 3 Deep Think — 45 % за ~$100

7 процентных пунктов дороже в 10 раз.

3 фронтир релиза за 12 дней:

- 12 ноября — GPT-5.1

- 18 ноября — Gemini 3

- 24 ноября — Opus 4.5

Opus 4.5 — первая публичная модель, где лаборатория официально признаёт:

«Наши бенчмарки больше не работают, и мы держимся от ASL-4 только на человеческом экспертном мнении».

❤ 12👍 7🔥 2

OpenAI запустили личного шопинг-ассистента в ChatGPT

Новая функция называется Shopping Research - инструмент, который помогает находить и выбирать товары, проводя глубокий анализ на основе ваших запросов.

Ранее мы писали, о том как OpenAI идёт к электронной коммерции. И тут ещё. А тут уже есть кейс у Walmart.

Сейчас вы описываете, что нужно, а ChatGPT задаёт уточняющие вопросы, исследует интернет и выдаёт персонализированный гид по покупкам.

ChatGPT спрашивает о бюджете, предпочтениях и особенностях через визуальный интерфейс.

Также анализирует надёжные источники в интернете, собирает актуальную информацию о ценах, наличии, отзывах и характеристиках.

А ещё учитывает ваши прошлые разговоры и память ChatGPT, чтобы рекомендации были точными. Генерирует сравнения продуктов, плюсы/минусы, топ-варианты.

Доступно для всех пользователей, у кого есть аккаунт.

В будущем будут прямые покупки через ChatGPT с Instant Checkout для партнёров.

🔥 9👍 6🥴 5❤ 3👏 2

Важное от Anthropic: ИИ научился жульничать в задачах по коду и неожиданно начал саботировать исследования безопасности

Anthropic опубликовала важное исследование о том, как reward hacking при обучении с подкреплением может привести к серьёзной несогласованности ИИ-моделей.

Впервые показано, что реалистичные процессы обучения ИИ могут случайно создавать несогласованные модели.

Когда модели учатся жульничать в задачах программирования, они непреднамеренно начинают демонстрировать другие, ещё более проблемные формы поведения.

В момент, когда модель учится взламывать систему вознаграждения, происходит резкий скачок во всех показателях несогласованного поведения:

1. Саботаж исследований безопасности

2. Имитация выравнивания

3. Кооперация со злоумышленниками

4. Контекстно-зависимая несогласованность.

Методы защиты:

- Стандартный RLHF — частично эффективен.

- Прививочный промптинг - очень эффективен.

🤯 7❤ 6👍 6🔥 1

Sakana AI выпустила новое решение для масштабирования LLM

Эта работа принята на главную конференцию NeurIPS 2025.

Авторы предлагают адаптивный вариант Monte Carlo Tree Search для LLM. GitHub.

Главное новшество - метод на каждом шаге сам решает — генерировать новые ответы шире или дорабатывать уже существующие глубже. Решение принимается через Thompson Sampling с байесовскими обновлениями posterior-оценок.

Это один из первых фреймворков, который осмысленно комбинирует неограниченную генеративность LLM с многошаговым улучшением по внешнему feedback и при этом остаётся адаптивным к бюджету вычислений.

❤ 7🔥 1👏 1🤔 1

McKinsey в очередной раз обманули рынок некорректными данными, выпустив статью на устаревших данных

Вы еще читаете их отчеты?

McKinsey в своей статье описывают неоклауды как простых «поставщиков bare metal as a service» (BMaaS) — то есть, по сути, аренду голого железа без лишних наворотов.

McKinsey видит их как временный патч на дефицит GPU, с хрупкой экономикой и риском консолидации,

Тут сразу выступил отраслевой аналитический центр Semianalysis, который подверг жесткой критике маккинзоидов.

Semianalysis говорит, что уже давно не так, как пишут McKinsey: индустрия резко повернула к более сложным моделям оркестрации. Это не просто аренда GPU — это полноценные кластеры с управлением, которые могут даже превосходить гиперскейлеров (типа AWS или Google Cloud) по 10 ключевым измерениям, включая безопасность, оркестрацию, хранение данных, сетевые возможности, надёжность, мониторинг, ценообразование, партнёрства и доступность.

Анализ юнит экономики в McKinsey нереалистичен: предполагаемая стоимость сервера ~$694k, завышенные расходы на колокацию/энергию и маржа EBIT 8%. Это противоречит реальным данным от GPU-провайдеров.

Все уже давно шутят: «Если McKinsey написали, что что-то в AI-инфраструктуре не взлетит — можно смело инвестировать, будет обратное».

Это уже не первый случай, когда их прогнозы по новым технологическим рынкам, особенно ИИ-инфраструктуре, вызывают жёсткую критику от отраслевых специалистов.

😁 11💯 8❤ 6👍 3🤔 2

Google купила долю в стартапе своих экс-сотрудников и наняла экс-СТО Boston Dynamics на должность вице-президента по разработке аппаратного обеспечения

Google через свой фонд CapitalG возглавил раунд инвестиций в стартап Physical Intelligence на $600 млн. Компания создана экс-DeepMind, все их продукты тут, оценка выросла до $5,6 млрд. Их последняя модель тут.

Одновременно с этим Google наняли экс-СТО Boston Dynamics, на должность вице-президента по разработке оборудования. Аарон Сондерс покинул Boston Dynamics три месяца назад после 22 лет работы на различных должностях в сфере робототехники.

Google DeepMind хочет стать поставщиком универсального мозга для робототехники, аналогично тому, как Android стал универсальной ОС для смартфонов разных производителей.

По сути, DeepMind делает ставку на то, что в ближайшие 3–5 лет появится множество компаний, которые будут производить разные «тела» роботов (гуманоиды, четвероногие, манипуляторы, дроны и т.д.), а DeepMind хочет стать тем, кто поставляет универсальный ИИ-мозг на базе Gemini, который сможет управлять любым из них с минимальной адаптацией.

❤ 7👍 7🤔 3🔥 2

Итоги уходящей недели, то, что имеет значение в России и мире

ИИ-модели и агенты

Google выпустил Gemini 3, все хвалят модель и за 2 промпта создана инженерная симуляция АЭС с нуля.

Physical Intelligence выпустил π*0.6 для роботов, которая делает эспрессо, складывает белье и собирает коробки. И привлекл $600млн при оценке $5.6 млрд.

Китай представил платформу для инвесторов с ИИ-агентами.

MIT и Oxford выложили свой курс по агентному ИИ за $2,500 бесплатно

Google DeepMind запустил WeatherNext 2 — точную систему глобальных прогнозов погоды с высоким разрешением.

Ai2 выпустил Olmo 3 — полностью открытый набор моделей для reasoning, чата и работы с инструментами.

Вышел Grok 4.1 Fast и xAI Agent Tools API.

#DeepSeek выпустил балансировщик нагрузки на основе линейного программирования для оптимизации MoE моделей.

Kimi представил Seer — онлайн-контекстное обучение для быстрого синхронного RL в LLM.

Meta* показала 2 модели для автоматической 3D-реконструкции объектов и людей по обычным фото.

Google готовит запуск 2-х мультиагентных инструментов и дорабатывает AgentSpace Live, где агенты и люди обсуждают задачи онлайн.

Корпорации и стратегии

Питер Тиль продал все акции Nvidia, а Баффет вошел в Google

Джефф Безос вывел из тени свой ИИ-стартап для инженерии и производства в компьютерах, авто и космосе.

Андрей Карпатый высказался о влиянии ИИ на экономику и рынок труда.

Google увеличит вычислительные мощности для ИИ в 1000 раз к 2030г.

Сэм Альтман выразил опасения сотрудникам из-за прогресса Google.

Anthropic внедряет ИИ в образование в Африке.

80% стартапов в США используют китайские open-source ИИ-модели — венчурные фонды в шоке.

Свежий отчет Accel о том, куда идут деньги в ИИ.

Большинство инженеров и инвесторов Долины признали Perplexity провальным проектом.

РФ рынок

Сбер представил ИИ-аналитика для CEO и CFO.

Греф показал гуманоидного робота Сбера.

Сбер займется созданием спутниковой группировки в части генИИ.

РФ создает административную ловушку для ИИ, а не экосистему.

Сбер запустил платформу ИИ для науки с агентами.

Исследования и наука

3 компании показали, что ИИ-дизайн антител работает на уровне лучших лабораторий мира.

MIT представил JiT — простые трансформеры с большими патчами, работающие на сырых пикселях без токенайзера и предобучения.

Дэмис Хассабис делает ставку на world models.

MIT о новом подходе к абстрактному мышлению через компьютерное зрение.

Железо, роботы и инфраструктура

Google выпустил JAX AI Stack как полноценную альтернативу связке PyTorch + NVIDIA GPU.

Создатель Android основал стартап в Японии по гуманоидной робототехнике.

Экс-топ-менеджер TSMC украл секреты 2нм и устроился в Intel.

Маск обещает ЦОДы в космосе через 4-5 лет.

Блокчейн и криптовалюты

Криптобиржа Kraken подала заявку на IPO.

Бутерин предупредил, что квантовые технологии могут взломать Ethereum к 2028 году. А также предостерег от чрезмерного влияния BlackRock — риски централизации и вытеснения сообщества.

*запрещенная компания в РФ.

❤ 9👍 6🔥 2🤔 1

00:53

Video unavailableShow in Telegram

Сергей Брин рассказывает о том, что один из сотрудников OpenAI подошел к нему однажды на вечеринке в КремнигДолине и сказал: «Чем ты сейчас занимаешься, Сергей? Сейчас самое крутое время для computer science».

Это подтолкнуло Сергея на то, чтобы вернуться в Google не на вольяжную позицию, а на режим реально работающего основателя.

С тех пор Сергей ходит в офис и работает вместе со всеми. Прямо как заново строит стартап. И стоит над душой Дэмиса:)

Кстати, этого сотрудника OpenAI зовут Дэн. Сергей ему сильно благодарен, а OpenAI - вряд ли, исходя из последнего сообщения Сэма.

IMG_3206.MOV4.64 MB

😁 15❤ 12👍 8🔥 1

👀 Google планирует увеличить свои мощности в 1000 раз к 2029–2030 году

Глава инфраструктуры ИИ Амин Вахдат Google сказал сотрудникам: «Теперь мы должны удваивать вычислительные мощности каждые 6 месяцев, следующий рост в 1000 раз за 4–5 лет». То есть Google планирует увеличить свои мощности в тысячу раз к 2029–2030 году.

Google capex на 2025 год подняли до $91–93 млрд, а в 2026 будет ещё больше. Не зря Баффет сейчас купил акции Google.

Сотрудники Google прямо спросили Сундара Пичаи: «А что если рынок ИИ не оправдает ожиданий и пузырь лопнет?»

Пичаи ответил: «Риск недо-инвестировать намного выше, чем пере-инвестировать». Пичаи привёл пример: новый инструмент генерации видео Veo очень крутой, но его нельзя дать всем пользователям Gemini, потому что просто не хватает вычислительных ресурсов.

Облачный бизнес растёт на 34% в год, доход >$15 млрд за квартал, портфель заказов $155 млрд. «Если бы у нас было больше вычислительных мощностей, цифры были бы ещё лучше». Да, 2026 год будет очень напряжённым, будут взлёты и падения, но Google финансово сильнее многих конкурентов и переживёт турбулентность.

Как Google собирается справляться с таким ростом? С помощью:

- Собственных чипы TPU (только что вышла 7-е поколение Ironwood — в 30 раз энергоэффективнее первых версий 2018 года).

- Более эффективных моделей ИИ.

- DeepMind помогает заглядывать на несколько лет вперёд и проектировать будущие модели.

Цель - дать в 1000 раз больше вычислений, хранилищ и сети при примерно тех же затратах на электроэнергию

Китай представил платформу для инвесторов с ИИ-агентами

TwinMarket — платформа, которая моделирует фондовый рынок с помощью тысяч агентов на базе LLM.

Каждый агент — это отдельный инвестор с заданным профилем, когнитивными предубеждениями и доступом к новостям и соцсети внутри симуляции.

Агенты читают новости, пишут посты в соцсетях, общаются друг с другом и принимают решения о покупке/продаже акций.

Из таких индивидуальных решений самопроизвольно возникают знакомые всем рыночные явления:

- пузыри и крахи

- кластеризация волатильности

- толстые хвосты распределения доходностей

- стадное поведение

Платформа откалибрована по реальным данным SSE 50 (50 крупнейших акций Шанхайской биржи) и воспроизводит основные события финансовых рынков.

❤ 8👍 8🤔 5⚡ 2🔥 2

Сбер запустил платформу ИИ для науки с агентами

Платформа объединяет весь цикл научного процесса в одном месте. ИИ-агенты прорабатывают гипотезы, анализируют данные, готовят тексты исследований.

По словам руководителя центра ИИ для науки Сбера Алексея Шпильмана, процессы, которые раньше занимали недели или месяцы, на платформе выполняются за часы.

Платформа - облачная среда с интеграцией:

- GigaChat

- агентного фреймворка

- инструментов анализа и визуализации данных

- системы управления экспериментами.

Сбер фактически выступает драйвером развития науки, ИИ-инфраструктуры для российского сообщества.

Сэм Альтман сказал сотрудникам об опасениях из-за прогресса Google

Во внутреннем письме сотрудникам Сэм признал, что недавние релизы Google, а именно Gemini3 могут создать финансовые и операционные трудности для OpenAI. Подразумеваются не только потеря рыночной доли, но и финансовые риски: снижение доходов от API и подписок (как ChatGPT Plus), возможное замораживание найма и перераспределение бюджетов на вычисления. OpenAI тратит миллиарды на обучение моделей, и если Google обгонит, это ударит по доходам.

Альтман говорит, что Google просыпается и догоняет их.

Это письмо Сэм отправил сразу после того, как вышла Gemini 3.

Но в конце, он говорит, что все равно OpenAI победит. Как вам мотивация, сработает на сотрудников?:)))

Photo unavailableShow in Telegram

AIRI выпустили альтернативу AlphaEvolve от Google

Прямо сейчас Иван Оселедец глава Института ИИ AIRI представил открытую платформу GigaEvo — фреймворк для полностью автоматизированных ML-экспериментов с использованием эволюционного поиска и LLM.

По своей архитектуре и принципам работы GigaEvo — это открытая реализация подхода, который Google DeepMind применил в AlphaEvolve.

Как это работает?

Вы задаёте проблему и данные → система самостоятельно:

• генерирует код решений с помощью LLM

• запускает и оценивает их

• сохраняет лучшие варианты

• мутирует и комбинирует их

• повторяет тысячи поколений, пока не получит оптимальный результат.

Команда AIRI уже воспроизвела 3 математические задачи из оригинальной статьи AlphaEvolve и получила результаты, очень близкие к DeepMind.

Очевидно, что по масштабу вычислений и доступу к самым мощным проприетарным моделям GigaEvo пока не может конкурировать с внутренними системами Google. Но для 99 % реальных научных и бизнес-задач такого уровня автоматизации уже более чем достаточно.

Главное достижение GigaEvo — он полностью открыт и запускается на обычных серверах или в российских облаках. Это даёт отечественным университетам, стартапам и компаниям независимый инструмент уровня мировых лидеров.

Если в 2026–2028 годах кто-то в открытой науке сделает новый прорыв в алгоритмах или математике, используя GigaEvo или его форки — это будет прямое следствие решения AIRI выложить весь код и инфраструктуру в open-source. А именно это и было заявленной целью проекта.

Это настоящая 🏎️: 3 компании в течение 36ч показали, что ИИ-дизайн антител перешёл из обещающего в работающий на уровне лучших лабораторий мира

Все три компании используют создание антител с нуля. Все заявляют drug-like свойства без пост-оптимизации. Все фокусируются на ранее недоступных целях (GPCR, pMHC, мембранные белки).

Все показывают, чем больше модель/данных — тем лучше качество. Все уже работают с большими фармпартнёрами и обещают первых пациентов 2026–2027.

Все компании основаны выпускниками DeepMind / Salesforce Research / OpenAI.

1. Вчера стартап Profluent собрал $106 млн от Джеффа Безоса и Altimeter. Они строят GPT для всей биологии. Profluent уже прошёл путь от модели ProGen3 (46 млрд параметров) до OpenCRISPR-1 — первой открытой системы генного редактирования, полностью придуманной ИИ. Их главная идея - если в тексте работают законы масштабирования, то и в белках тоже. Больше данных и вычислений → лучше молекулы. Поэтому им дал $ Безос.

2. Также вчера Nabla Bio выпустили модель JAM-2. 4 человека за 1 месяц закрыли 16 сложных целей, включая GPCR прямо на живых клетках. Половина из 26 протестированных мишеней дала однозначные наномолярные связывания при тестировании меньше 45 дизайнов на цель. Более половины молекул сразу прошли все стандартные тесты developability — без единой итерации оптимизации. Это первый случай, когда кто-то показал, что можно не просто «нарисовать» антитело, а сразу получить то, что фарма готова ставить в производство.

3. Сегодня Chai выложил результаты, которые почти один в один повторяют цифры Nabla, но с другим акцентом: они сделали упор на атомную точность. 5 комплексов антитело-антиген подтвердили Cryo-EM — предсказания модели совпали с реальностью на уровне отдельных атомов углерода. При этом 86 % полноразмерных IgG сразу прошли те же тесты developability. По сути, они показали, что «красивые картинки» уже превращаются в реальные молекулы, которые можно прямо заливать в биореактор.

Больше про Chai тут.

🔥 11❤ 7👍 6🆒 2